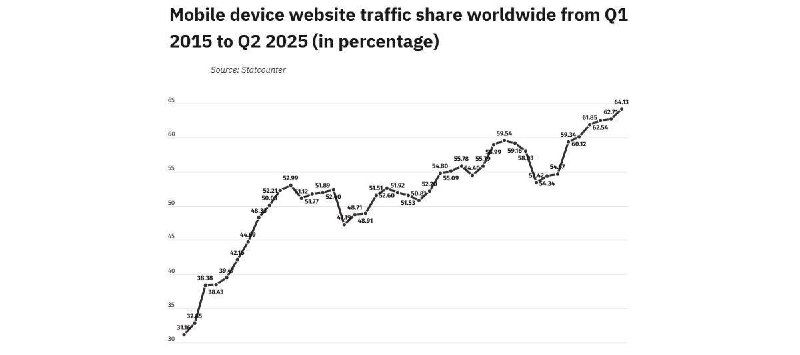

Apple最新研究探讨了大型语言模型(LLMs)中的“大型推理模型”(LRMs)。尽管它们在推理任务上展现出优势,但其根本能力与局限仍未充分理解。研究引入具可控复杂度的逻辑谜题环境,深入分析LRMs的推理路径与行为模式,为理解其能力极限提供关键洞察,并提出对其真正“推理能力”的质疑。

实验表明,LRMs在复杂度达到某一阈值后,准确率完全崩溃,且其推理努力呈现先增后减的非线性趋势,尽管计算资源充足。与标准LLMs对比下,研究发现:在简单任务中传统模型反超;中等任务中LRMs具优势;复杂任务中两者均失效。此外,LRMs在精确计算与一致性推理方面存在明显短板,无法有效调用明确算法。

Apple机器学习研究(英文)

📮投稿 ☘️频道

⭐ 2 🤣 217 👍 37 ❤️ 13 😁 4 🥱 3 🔥 2  2 🌭 1

2 🌭 1